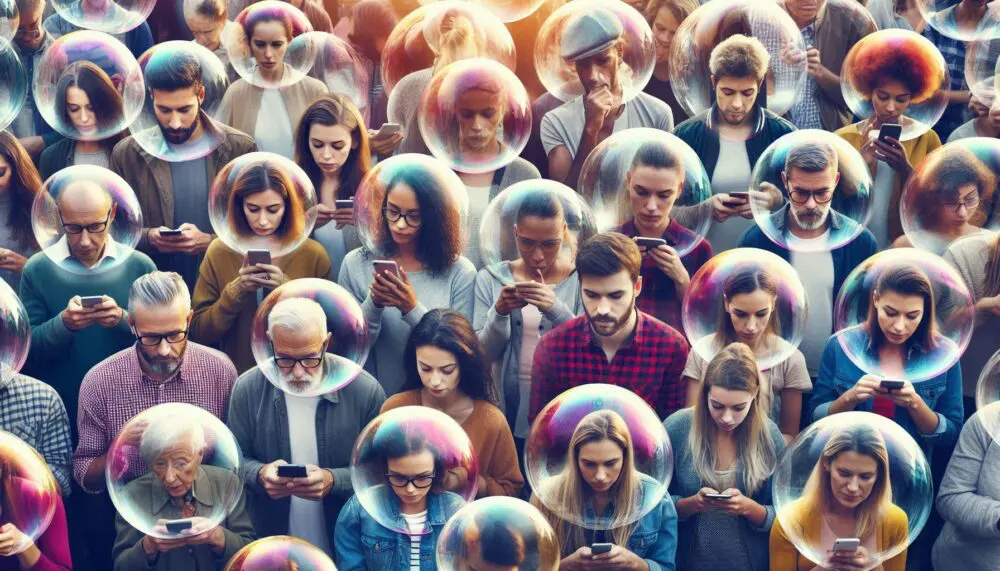

La huella imperceptible en redes sociales, streamings y otras plataformas de la algoritmia de recomendación y de sus burbujas de filtro influye en nuestros consumos y opiniones, y contribuye a la polarización

En la era digital, las redes sociales se han convertido en una herramienta fundamental para la comunicación, el entretenimiento y la información. Pero, ¿qué hay detrás de las publicaciones que vemos en nuestro feed? ¿Cómo se decide qué contenido nos llega y en qué orden? La respuesta está en los algoritmos, y dentro de ellos, los logaritmos juegan un papel crucial.

¿A quién no le sucede en el smartphone, o en el navegador de la computadora, en Instagram, Facebook y demás aplicaciones, alguna de las situaciones siguientes?

Imaginen a un joven en Buenos Aires buscando información sobre un recital de su banda favorita. Tras navegar unos minutos, le comienzan a aparecer anuncios de entradas, recomendaciones de música similar, e incluso sugerencias de hospedaje cercanos al lugar del evento.

O en México, una madre busca consejos sobre crianza y se ve inmersa en grupos de Facebook con posturas muy definidas sobre vacunación, generando intensos debates.

O en España, donde un usuario tras ver un documental histórico, es bombardeado con contenido de teorías conspirativas sobre ese mismo evento.

En Estados Unidos, un votante indeciso comienza a ver contenido político polarizado que refuerza sus dudas y prejuicios.

Estos no son hechos aislados, sino ejemplos del poder omnipresente de los algoritmos de recomendación, arquitectos silenciosos de nuestra experiencia online.

Las redes sociales, como Facebook, Instagram, Twitter o TikTok, utilizan algoritmos para determinar qué contenido mostrar a cada usuario. Estos algoritmos son complejos sistemas que tienen en cuenta diversos factores, como la interacción del usuario con publicaciones anteriores, sus intereses, la popularidad de las publicaciones y la actividad de sus amigos.

Dentro de estos algoritmos, los logaritmos son una herramienta matemática clave. Un logaritmo es, en esencia, una función que mide la relación entre dos magnitudes. En el contexto de las redes sociales, los logaritmos se utilizan para ponderar la importancia de las diferentes variables que influyen en la visibilidad de una publicación.

Por ejemplo, la cantidad de “me gusta” o “retuits” que recibe una publicación puede ser medida utilizando una escala logarítmica. Esto significa que cuanto más popular sea una publicación, más “peso” tendrá en el algoritmo, pero ese peso aumenta de forma gradual, no lineal.

Los logaritmos también se utilizan para medir la “relevancia” de una publicación para un usuario en particular. El algoritmo analiza la actividad del usuario en la red social, como las páginas que sigue, las publicaciones con las que interactúa y las búsquedas que realiza, y utiliza logaritmos para calcular la probabilidad de que una determinada publicación le interese.

Sugerencias a tu medida

Diseñados para personalizar nuestra interacción con el contenido, estos sistemas inteligentes analizan nuestros datos y comportamientos para ofrecernos sugerencias “a medida”.

Sin embargo, esta aparente conveniencia tiene un precio: la configuración de nuestra percepción de la realidad.

Los algoritmos de recomendación, en su afán por maximizar el engagement o nivel de compromiso e interacción con el usuario o consumidor, pueden crear “burbujas de filtro”.

Las burbujas de filtro limitan nuestra exposición a diversas perspectivas, contribuyendo a la polarización social y redefiniendo la forma en que interactuamos con el mundo.

El backstage de los algoritmos

Los algoritmos de recomendación operan detrás de escena, recopilando información sobre nuestras actividades online.

Cada clic, cada búsqueda, cada “me gusta”, así como el tiempo de permanencia en una página, se convierte en un dato que alimenta estos sistemas. Existen principalmente tres tipos de algoritmos:

- Filtrado Colaborativo

Se basa en la premisa de que usuarios con gustos similares también disfrutarán de contenido similar. El sistema analiza las preferencias de un grupo de usuarios y recomienda elementos que han gustado a otros usuarios con perfiles parecidos. - Filtrado Basado en Contenido

Analiza las características del contenido que has consumido previamente y te recomienda elementos con atributos similares. Por ejemplo, si ves muchas películas de ciencia ficción, te recomendará otras películas de ese género. - Sistemas Híbridos

Combinan ambos enfoques para ofrecer recomendaciones más precisas y personalizadas.

¿Qué es un Algoritmo de Recomendación?

Es un sistema informático que utiliza datos y patrones de comportamiento para predecir y sugerir elementos que un usuario podría encontrar interesantes o relevantes.

Estos elementos pueden ser productos, música, videos, noticias, contactos sociales, entre otros.

El Sesgo Algorítmico

El problema surge cuando los datos que alimentan a estos algoritmos contienen sesgos inherentes.

Si los datos históricos reflejan desigualdades sociales o estereotipos, el algoritmo los aprenderá y los perpetuará.

Los algoritmos no solo influyen en qué consumimos, sino también en cómo lo consumimos.

Las redes sociales, con sus algoritmos diseñados para maximizar el engagement, se han convertido en un caldo de cultivo para la desinformación y la polarización.

El “bombardeo” constante de información personalizada crea una sensación de confirmación continua, reforzando nuestras creencias y generando una adicción a la validación externa. Psicológicamente, esto puede derivar en:

- Sesgo de confirmación: Buscamos y valoramos la información que confirma lo que ya creemos.

- Disonancia cognitiva: Experimentamos malestar cuando nos enfrentamos a información que contradice nuestras creencias.

- Ansiedad y depresión: La comparación constante con las vidas “perfectas” que se muestran en redes sociales puede generar sentimientos de inferioridad y baja autoestima.

- FOMO (Fear of Missing Out): El miedo a perderse algo importante que está sucediendo en las redes sociales.

Sesgo en el reconocimiento facial

Estudios del MIT Media Lab y el National Institute of Standards and Technology (NIST) en Estados Unidos demostraron consistentemente que los sistemas de reconocimiento facial tienen tasas de error significativamente mayores al identificar rostros de personas de piel oscura, especialmente mujeres. Esto se debe a que los conjuntos de datos utilizados para entrenar estos algoritmos estaban predominantemente compuestos por imágenes de personas de piel clara. Esto genera consecuencias graves, como falsos positivos en identificaciones policiales, con el consiguiente riesgo de detenciones injustas.

Cómo escapar de la burbuja de filtro

Mitigar los efectos negativos de los algoritmos requiere un enfoque multifacético que involucre a usuarios, empresas y gobiernos.

No se trata de demonizar la tecnología, sino de comprenderla y utilizarla de forma responsable.

Algunos tips:

Diversificar las fuentes de información

No te limites a las recomendaciones de los algoritmos. Busca activamente fuentes de información con diferentes perspectivas.

Utilizar herramientas de búsqueda alternativas

Prueba buscadores que prioricen la privacidad y la diversidad de resultados, como DuckDuckGo o Startpage. Estos buscadores no personalizan los resultados en función de tu historial de búsqueda.

Seguir cuentas con perspectivas diferentes en redes sociales

Proponete exponerte a puntos de vista que desafíen tus propias creencias.

Verificar la información antes de compartirla

No contribuyas a la difusión de desinformación. Utiliza herramientas de verificación de datos como Snopes, PolitiFact, Chequeado (para Latinoamérica) o Maldita.es (para España).

Ser consciente de los sesgos algorítmicos

Reconoce que los algoritmos están diseñados para mostrarte lo que creen que quieres ver, no necesariamente la realidad completa. Cuestiona las recomendaciones que recibes y busca información complementaria.

Participar en debates constructivos

Intenta dialogar con personas que tienen puntos de vista diferentes, buscando entender sus argumentos y expresar los tuyos de forma respetuosa. Evita caer en la descalificación personal o en la polarización.

Utilizar extensiones de navegador para diversificar el contenido

Existen extensiones de navegador que te muestran diferentes perspectivas sobre un mismo tema o que te ayudan a identificar noticias falsas.

Limpiar el historial de navegación y cookies

Esto puede ayudar a “resetear” las recomendaciones de los algoritmos.

Utilizar el modo incógnito o VPN

Navegar en modo incógnito o utilizando una VPN puede dificultar que los algoritmos rastreen tu actividad y personalicen las recomendaciones.

Ajustar la configuración de privacidad en las redes sociales

Revisa la configuración de privacidad de tus redes sociales y limita la cantidad de datos que compartes con las plataformas. Desactiva la personalización de anuncios cuando sea posible.

Fomentar la alfabetización digital en tu entorno

Comparte esta información con amigos y familiares. Cuanto más conscientes seamos del funcionamiento de los algoritmos, mejor podremos navegar el mundo digital.

El debate ético y las regulaciones

La falta de transparencia de los algoritmos plantea serias cuestiones éticas. ¿Quién es responsable de los efectos negativos que generan?¿Cómo podemos regular su uso sin coartar la innovación?¿La regulación es un arma de doble filo?

Hay consenso entre los actores de este dilema que la regulación puede ser un arma de doble filo. Si bien busca proteger al usuario de la manipulación algorítmica, también puede otorgar un poder de control sin precedentes a los gobiernos, abriendo la puerta a la censura y la vigilancia masiva.

Este delicado equilibrio requiere un debate público informado y una cuidadosa consideración de las implicaciones a largo plazo.

Ejemplos de regulaciones en vigor y de proyectos en curso

- Unión Europea: La UE se encuentra a la vanguardia de la regulación de la IA y las plataformas digitales, con dos legislaciones clave:

- Ley de Servicios Digitales (DSA – Digital Services Act): Esta ley se centra en regular las plataformas online, incluyendo las redes sociales y los motores de búsqueda. Busca crear un espacio digital más seguro para los usuarios, combatiendo la difusión de contenido ilegal y exigiendo mayor transparencia en el funcionamiento de los algoritmos. Algunos aspectos clave de la DSA son:

- Mayor transparencia algorítmica: Las plataformas deberán informar sobre los parámetros principales que utilizan sus algoritmos para recomendar contenido.

- Mecanismos de denuncia: Se facilitará a los usuarios la denuncia de contenido ilegal.

- Evaluaciones de riesgo: Las grandes plataformas deberán realizar evaluaciones de riesgo sobre el impacto de sus servicios en la sociedad, incluyendo el impacto en la polarización y la difusión de desinformación.

- Obligaciones para plataformas muy grandes: Las plataformas con más de 45 millones de usuarios en la UE estarán sujetas a obligaciones más estrictas.

- Ley de Mercados Digitales (DMA – Digital Markets Act): Esta ley se enfoca en regular el poder de mercado de las grandes plataformas digitales (“gatekeepers”) para evitar prácticas anticompetitivas. Busca asegurar una competencia justa en los mercados digitales y dar más opciones a los usuarios. Algunos aspectos clave de la DMA son:

- Interoperabilidad: Se busca que los servicios de mensajería sean interoperables entre diferentes plataformas.

- Limitaciones a las prácticas de auto-preferencia: Se limitará la capacidad de las grandes plataformas para favorecer sus propios servicios frente a los de la competencia.

- Mayor control para los usuarios: Se busca dar a los usuarios mayor control sobre sus datos y sobre las aplicaciones que utilizan.

- Ley de Servicios Digitales (DSA – Digital Services Act): Esta ley se centra en regular las plataformas online, incluyendo las redes sociales y los motores de búsqueda. Busca crear un espacio digital más seguro para los usuarios, combatiendo la difusión de contenido ilegal y exigiendo mayor transparencia en el funcionamiento de los algoritmos. Algunos aspectos clave de la DSA son:

- Alemania: ha implementado la NetzDG (Netzwerkdurchsetzungsgesetz), una ley que obliga a las redes sociales a eliminar contenido ilegal, como discursos de odio, en un plazo determinado. Esta ley ha sido objeto de debate por su posible impacto en la libertad de expresión, pero sirve como un ejemplo de cómo los países están buscando responsabilizar a las plataformas por el contenido que se difunde en ellas.

- Francia: ha aprobado leyes contra la manipulación de la información en periodos electorales, buscando combatir la difusión de noticias falsas. Estas leyes se enfocan en la transparencia de la publicidad política en línea y en la lucha contra la desinformación durante las campañas electorales.

- Australia: ha tomado medidas significativas, incluyendo una ley pionera para prohibir el acceso de menores de 16 años a las redes sociales y contempla multas cuantiosas para las plataformas que la infrinjan. También se han implementado medidas para combatir la desinformación en línea, incluyendo la creación de un código de conducta voluntario para las plataformas digitales.

- Reino Unido: está trabajando en la Online Safety Bill, que busca regular el contenido en línea y responsabilizar a las plataformas por el contenido dañino que se difunde en ellas. Esta ley se enfoca en proteger a los usuarios, especialmente a los menores, de contenido ilegal y dañino en línea.

- Canadá: está considerando una legislación similar a la DSA europea para regular las plataformas digitales. El gobierno canadiense ha expresado su intención de crear un marco regulatorio que aborde los desafíos planteados por las plataformas digitales, incluyendo la desinformación, el discurso de odio y la protección de la privacidad.

- Estados Unidos: a nivel federal, el debate está en curso, con diversas propuestas para reformar la Sección 230 de la Communications Decency Act, que protege a las plataformas de la responsabilidad por el contenido publicado por sus usuarios. A nivel estatal, algunos estados como California y Nueva York están implementando sus propias regulaciones, enfocadas principalmente en la protección de la privacidad de los menores y la limitación del uso de algoritmos para dirigir contenido a menores.

- Brasil: ha avanzado significativamente en la regulación de la IA. El Senado brasileño aprobó el Proyecto de Ley 2338/23, que busca establecer un marco regulatorio para la inteligencia artificial (IA) bajo principios de “gobernanza responsable”.

- México: se han presentado diversas iniciativas en el Congreso para regular la IA, enfocándose principalmente en la ética, la transparencia y la protección de datos personales. Si bien aún no existe una ley federal específica, se han realizado foros y consultas públicas para discutir el tema y se espera que en el futuro cercano se presenten propuestas más concretas. El trabajo de la Red Nacional de Inteligencia Artificial (RENIA) es parte de los esfuerzos para promover el desarrollo y uso ético de la IA en México.

- Argentina: el debate sobre la regulación de la IA se encuentra en una etapa de desarrollo. No existe una ley específica que regule la IA de manera integral, pero hay proyectos en discusión y elaboración de propuestas. Algunos puntos clave a considerar son:

- Enfoque en principios éticos: Las iniciativas en Argentina tienden a enfocarse en el establecimiento de principios éticos para el desarrollo y uso de la IA, como la transparencia, la responsabilidad, la equidad, la privacidad y la seguridad.

- Protección de datos personales: La Ley de Protección de Datos Personales (Ley 25.326) juega un papel importante en la regulación del uso de datos para el desarrollo de sistemas de IA.

- Iniciativas en el ámbito educativo: Se han desarrollado documentos que buscan regular el uso de la IA en las instituciones educativas, enfocándose en la identificación de los sistemas utilizados, la implementación informada y la evaluación y monitoreo permanentes. Este proyecto busca asegurar que el uso de la IA en la educación se realice de manera ética y responsable, evitando el sesgo algorítmico y la manipulación de los estudiantes.

- Rol de la AAIP: La Agencia de Acceso a la Información Pública (AAIP) ha creado el “Programa de transparencia y protección de datos personales en el uso de la Inteligencia Artificial” (Resolución 161/2023), demostrando un compromiso con la transparencia y la rendición de cuentas en el uso de la IA.

- Participación en iniciativas internacionales: Argentina participa activamente en foros y organizaciones internacionales que trabajan en la regulación de la IA, como la OCDE y la UNESCO, buscando armonizar las normativas a nivel global.

- El debate en la sociedad civil: Organizaciones como la Fundación Vía Libre y otras instituciones de la sociedad civil están promoviendo un debate público informado sobre los aspectos éticos, legales y sociales de la IA.

- Desafíos: Uno de los desafíos principales en Argentina es encontrar un equilibrio entre la promoción de la innovación en IA y la protección de los derechos de los ciudadanos, así como la necesidad de generar capacidades técnicas y recursos para la implementación y el control de las regulaciones.

- Colaboración con otros países: Argentina participa en iniciativas internacionales y regionales para el desarrollo de marcos regulatorios para la IA, buscando armonizar las normativas a nivel global.

El riesgo de la manipulación de las regulaciones

Es fundamental considerar que la regulación, si no se diseña e implementa cuidadosamente, puede ser susceptible de manipulación.

Los gobiernos podrían utilizar estas regulaciones para censurar contenido crítico, controlar la narrativa pública o incluso para realizar vigilancia masiva.

Por lo tanto, es esencial que cualquier regulación se base en principios de transparencia, rendición de cuentas, independencia y respeto a los derechos humanos.

Los algoritmos de recomendación son una herramienta poderosa que ha transformado nuestra experiencia digital.

Sin embargo, es prudente para no ser manipulado comprender su funcionamiento y sus posibles efectos negativos para navegar el mundo digital de forma crítica y consciente.

No se trata de rechazar la tecnología, sino de utilizarla de manera informada y responsable, exigiendo mayor transparencia a las empresas y promoviendo un debate público sobre su impacto en la sociedad.

La configuración de nuestra percepción de la realidad no debe dejarse en manos de algoritmos opacos, sino que debe ser una elección consciente de cada individuo.

Fuentes:

- Textos legales:

- Unión Europea:

- Ley de Servicios Digitales (DSA): https://eur-lex.europa.eu/legal-content/ES/TXT/?uri=CELEX%3A52020PC0825

- Ley de Mercados Digitales (DMA): https://eur-lex.europa.eu/legal-content/ES/TXT/?uri=CELEX%3A52020PC0842

- Alemania: NetzDG (Netzwerkdurchsetzungsgesetz) (Buscar en el sitio web del Ministerio de Justicia alemán)

- Brasil: Proyecto de Ley 2338/23: https://www25.senado.leg.br/web/atividade/materias/-/materia/156350

- Unión Europea:

- Informes de organizaciones internacionales:

- OCDE: (Buscar informes específicos sobre IA y regulación en www.oecd.org)

- UNESCO: (Buscar informes específicos sobre IA y ética en www.unesco.org)

- Consejo de Europa: (Buscar informes específicos sobre IA y derechos humanos en www.coe.int)

- Estudios académicos y artículos de investigación:

- Pariser, E. (2011). The filter bubble: What the Internet is hiding from you. Penguin Press.

- O’Neil, C. (2016). Weapons of math destruction: How big data increases inequality and threatens democracy. Crown.

- Estudios del MIT Media Lab sobre reconocimiento facial (Buscar en www.media.mit.edu)

- Estudios del NIST sobre reconocimiento facial (Buscar en www.nist.gov)

- Informes de ONGs:

- Electronic Frontier Foundation (EFF): www.eff.org

- Access Now: www.accessnow.org

- Artículo 19: www.article19.org